Avant que nos smartphones ne deviennent nos compagnons de poche, l’informatique n’était qu’un murmure dans l’esprit de quelques visionnaires. Au 19e siècle, Charles Babbage imaginait une machine capable de calculer par elle-même. Une idée audacieuse, presque poétique: donner vie à des chiffres.

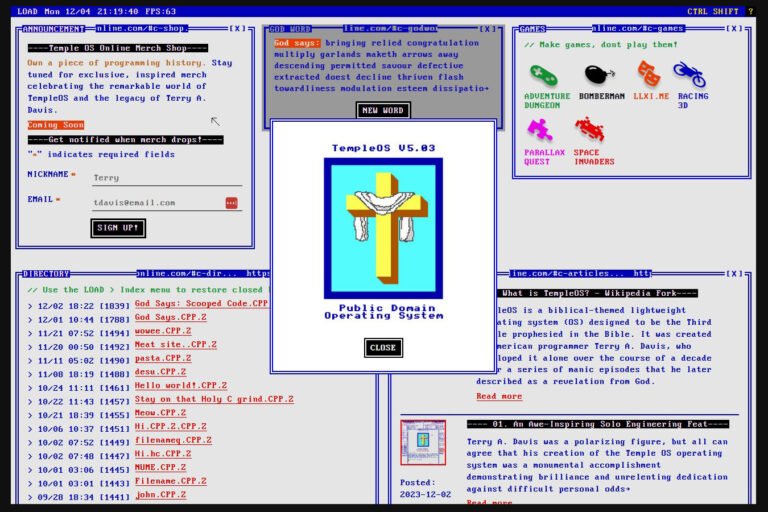

Le XXe siècle a ensuite poussé l’impossible un peu plus loin. De gigantesques ordinateurs occupant des salles entières, clignotant comme des étoiles industrielles, sont nés pour résoudre des calculs qui auraient pris des années aux humains. Puis sont arrivés les transistors, minuscules héros de silicium, ouvrant la porte à la miniaturisation et à la révolution personnelle de l’ordinateur.

Avec l’arrivée du web, le monde n’a plus eu besoin de frontières physiques. Une simple connexion pouvait transporter une idée d’un continent à l’autre, plus vite qu’une pensée ne cligne de l’œil. Et aujourd’hui, l’intelligence artificielle ne se contente plus d’obéir… elle apprend, elle s’adapte, et parfois, elle surprend.

L’informatique n’est pas seulement une histoire de machines. C’est l’histoire de l’humanité cherchant à dépasser ses limites, à accélérer son imagination et à transformer le monde avec des lignes de code au lieu de marteaux et de clous.